BTC/HKD+1.01%

BTC/HKD+1.01% ETH/HKD+1.45%

ETH/HKD+1.45% LTC/HKD+1.65%

LTC/HKD+1.65% ADA/HKD+1.5%

ADA/HKD+1.5% SOL/HKD+1.69%

SOL/HKD+1.69% XRP/HKD+1.52%

XRP/HKD+1.52%《三體》中的降臨派、拯救派和幸存派分別代表著不同的觀念和立場。借用這三個概念,我們可以將對AI看法的人劃分為AI降臨派、AI拯救派和AI幸存派。

AI降臨派:

這一派的人認為AI的發展將為人類帶來巨大的好處,甚至取代人類成為地球的主導力量。他們相信AI可以解決人類的許多問題,如氣候變化、資源分配、疾病治療等。AI降臨派的人通常對AI技術非常熱衷,支持無限制地發展和應用AI技術,期待AI在未來改變世界。

AI拯救派:

這一派的人認為AI是人類發展的關鍵,但需要在一定范圍內受到監管和引導。他們認為,通過合理的政策制定和倫理道德約束,可以確保AI技術的安全和可持續發展。拯救派關注AI對社會和個人產生的影響,期望在維護人類利益的同時,讓AI成為人類的得力助手。

AI幸存派:

這一派的人對AI技術持懷疑甚至擔憂的態度。他們認為AI技術的發展將可能導致一系列問題,如失業、隱私侵犯、安全威脅等。幸存派的人認為,人類應該小心應對AI技術的發展,尋求與AI和諧共生的方法。他們強調AI的潛在風險,提倡謹慎和審慎的態度來平衡AI技術的利弊。

這三派的劃分并沒有嚴格按照《三體》原著的定義,而是以人們對AI的接受程度以及欲施加的監管力度進行劃分。

Cardano鏈上NFT銷售總額突破6億美元,過去8個月增長接近35%:金色財經報道,據Cryptoslam最新數據顯示,Cardano鏈上NFT銷售總額已突破6億美元,本文撰寫時達到600,650,360美元,鏈上總買家數量1,264,521個,是鏈上NFT銷售總額第6大區塊鏈。歷史數據顯示,Cardano鏈上NFT銷售總額于去年11月達到約4.5億美元,這意味著該指標值在過去8個月增長接近35%。[2023/7/12 10:49:22]

降臨派接受程度最高,拯救派次之,幸存派最保守,以便于我們理解立場。

讓我們看看在這一周內,三派有哪些觀點碰撞。

降臨派

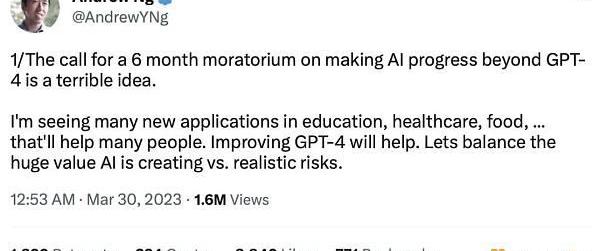

吳恩達:暫停AI開發不可行

本周,一封上千人簽署的公開信火遍了全網,一家名為未來生命研究所的機構呼吁全球應該至少暫停六個月開發比GPT-4更強大的模型,以讓有關的監管手段能夠跟上。

人們在該信上看到了許多知名人士的簽名,包括圖靈獎得主YoshuaBengio、馬斯克、史蒂夫·沃茲尼亞克、Skype聯合創始人、Pinterest聯合創始人、StabilityAICEO等人。

該信爆火后,人們發現部分知名人士的簽名實際上是網友冒簽的,所謂千人簽名的真實性存疑。

不管怎么說,這封公開信還是激起了人們關于是否要封禁AI研究的討論。

以太坊Dencun升級已獲得開發者們的最終確認:金色財經報道,以太坊開發者已經確認了網絡即將到來的全面升級,本次升級被稱為Dencun。本次升級包括五個EIP,旨在增加更多的數據存儲和降低費用。升級以EIP-4844為核心,除此之外,還包括EIP-1153、EIP-4788、EIP-5656、EIP-6780四項改進提案。目前還沒有升級的確切日期,但預計會在2023年底上線。[2023/6/9 21:24:47]

著名計算機科學家、GoogleBrain的聯合創始人吳恩達在社交媒體上發表了他對這封信的看法。

他認為,讓有關部門暫停他們尚未了解的新興技術,往好了說是反競爭,往壞了說是開了一個糟糕的先例。

以下是他的觀點原文:

要求在6個月禁止開展比GPT-4更進一步的研究是一個可怕的想法。我看到許多新的應用在教育,醫療保健,食品……這將幫助許多人。繼續改進GPT-4會對這些領域有所幫助。我們要權衡AI創造的巨大價值和現實的風險。

除非有關部門介入,否則沒有切實可行的方法來實施暫停并阻止所有團隊擴大LLM。讓有關部門暫停他們不了解的新興技術是反競爭的,樹立了一個可怕的先例,是糟糕的創新政策。

孫宇晨錢包地址向Poloniex交易所轉入6500枚ETH:12月13日消息,OKLink數據顯示,被標記為孫宇晨的地址(0x176F3DAb24a159341c0509bB36B833E7fdd0a132)10小時前向Poloniex交易所轉入6500枚ETH。目前該地址剩余233,780.57枚ETH,價值2.96億美元。[2022/12/13 21:40:59]

負責任的人工智能很重要,而且人工智能有風險。目前主流的媒體報道稱,人工智能公司正在瘋狂地發送不安全的代碼,這種說法是不正確的。絕大多數人工智能團隊都認真對待人工智能和安全問題。

暫停6個月不是一個切實可行的建議。為了提高人工智能的安全性,有關透明度和審計的規定應該變得更加切實可行,產生更大的影響。讓我們在推進技術進步的同時,在安全方面作更多的投資,而不是扼殺進步。

JimFan:我們應該欣賞GPT-4

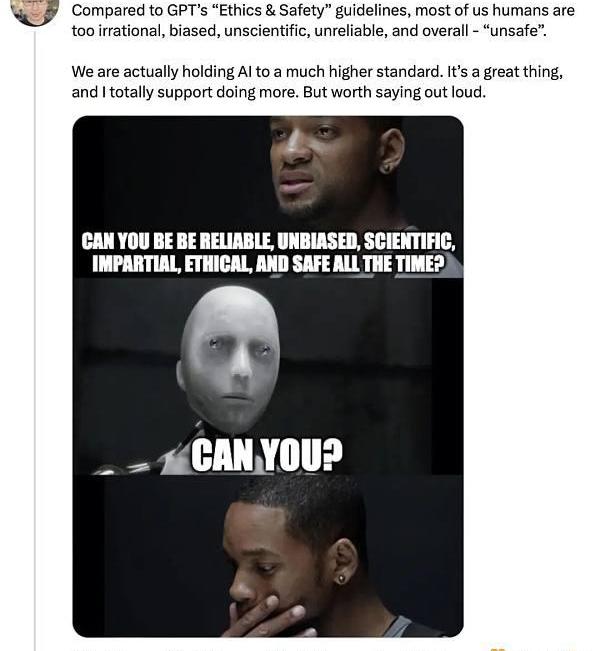

針對大語言模型的安全性,英偉達AI科學家JimFan提出了一個有意思的觀點。

他認為按照AI的行為規范,那么大部份人類也是「不安全」的,許多大語言模型在安全性和公正性上已經表現地很好,我們不應該一味地批評它們。

食品巨頭卡夫為其標志性“熱狗車”Weinermobile申請NFT商標:金色財經報道,據商標律師Mike Kondoudis在社交媒體上透露,食品巨頭卡夫(Kraft Foods)已為其標志性的“熱狗車”Weinermobile申請了NFT和元宇宙商標。根據美國專利商標局披露的申請信息顯示,卡夫食品公司將提供虛擬食品和飲料產品、NFT、以及基于實體和虛擬實物的線上元宇宙餐廳。此前卡夫食品公司還提交了“Kraft”、“Jell-O”、“Kool-Aid”、“Velveeta”、“Lunchables”、“Oscar Mayer”和“Philadelphia”等元宇宙和NFT商標申請。[2022/10/21 16:34:12]

以下是他的觀點原文:

按照GPT的「倫理與安全」指導方針,我們大多數人也表現得不理性、有偏見、不科學、不可靠,總的來說——「不安全」。事實上,我們對人工智能的要求更高。這是件好事,我完全支持做更多。但有些事不吐不快。

我指出這一點的原因是為了讓大家了解安全校準工作對于整個研究團體來說是多么困難。大多數的訓練數據本身就是有偏見的、有的、不安全的等等。實際上,創造一個安全的人工智能助手是違反人類數據分布的。

從某種意義上說,許多生產型LLM在安全性和公正性方面都是「超人」,盡管它們并不完美。對我們來說,下意識地批評失敗案例比欣賞挑戰更加容易。

印度政府消息人士:在引入加密貨幣監管立法之前,政府仍需要研究各個方面:8月11日消息,印度政府消息人士表示,在引入加密貨幣監管立法之前,政府仍需要研究各個方面。印度需要“謹慎”對待加密貨幣。(金十)[2022/8/11 12:18:58]

拯救派

SamAltman:確保AGI惠及全人類

生命研究所的公開信將OpenAI拉入了輿論的風暴之中,OpenAI的CEOSamAltman在Twitter上卻表示他依然很平靜,并提出了建立AGI的三個要點。

以下是他的觀點原文:

我們需要為了AGI美好的未來而付出的努力

1、調整超級智能的技術能力

2、充分協調大多數主要AGI的工作

3、有效的全球監管框架,包括民主治理

此前,SamAltman在LexFridman的采訪播客曾表示自己會對OpenAI的技術感到害怕,他表示:

當人們認為這是一個巨大的飛躍時,我會說,我有點害怕,我覺得這很奇怪。

我認為一點都不害怕的話才是瘋狂的,我同情那些非常害怕的人。

SamAltman更關心的是「虛假信息問題或經濟沖擊」,而不是如何用算法制造「超級智能」。他認為有些公司并不會像OpenAI一樣設置如此嚴格的安全柵欄,并擔心因此導致AI失控造成不良的社會影響。

馬云:ChatGPT只是AI時代的開始

馬云回國后來到云谷學校,聊到了ChatGPT對教育領域的影響。馬云表示,ChatGPT這一類技術已經對教育帶來挑戰,但是ChatGPT這一類技術只是AI時代的開始。

以下是他的觀點原文:

我們要用人工智能去解決問題,而不是被人工智能所控制,雖然人的體力、腦力比不過機器,但機器只有「芯」,而人有「心」。工業時代是知識驅動,知識的競爭;數字時代,是智慧驅動,是創造力和想象力的競爭,是領導力、擔當力、責任的競爭,是獨立思考的競爭。

幸存派

GaryMarcus:什么都不做是不對的

紐約大學心理學和神經科學的榮譽退休教授GaryMarcus一直對LLM保持批評的態度。

當生命研究所的公開信發布后,GaryMarcus可以說是該觀點最堅定的支持者。

面對該公開信受到的質疑,GaryMarcus做出了一段很長的回應,以下是他的觀點原文:

很多針對6個月禁止培訓超大型#LLM的攻擊都沒有抓住要點。

這么多的利害關系,這里有一個Twitter#longgread整理出什么才是真正重要的:

很多對這封信的攻擊都集中在贊助人身上,而不是署名人。大多數簽名的人與FLI沒有任何關系。評判這封信應該看它寫了什么,而不是誰寫的。這里真正的新聞不是埃隆·馬斯克簽署了協議,而是這么多不是天生盟友的人出于共同關心而走到了一起。

提出一個不同的選擇并沒有錯,而大多數批評這封信的人也沒給出一個恰當的解決辦法。

什么都不做是不好的。幾乎所有人,甚至包括OpenAI在內,都承認其存在嚴重的風險,但迄今為止,有關部門或行業都沒有采取什么切實措施來減輕這些風險。

并不是所有簽署了這封信的人都主要關心長期風險;我們中的許多簽署了這封信的人至少同樣擔心短期風險。

這封信并沒有呼吁禁止人工智能。沒有要求永久禁止。它沒有呼吁禁止GPT-4。它沒有呼吁禁止絕大多數人工智能研究,只是在一個非常具體的項目上短暫停頓了一下,該項目的技術已經「知道」存在風險,卻沒有已知的解決方案。實際上需要更多的研究。有人看過那封信嗎?

我個人沒有改變;我仍然認為LLM是不可靠的,仍然認為它們表達事實的能力非常糟糕。我不認為它們接近AGI。但這并不意味著他們沒有撕裂我們社會結構的潛力ーー特別是考慮到當前的混合情況:難以置信的廣泛和快速部署、企業不負責任、缺乏監管以及一直存在的不可靠性。

EliezerYudkowsky:暫停還不夠,我們應該把AI永遠關閉!

EliezerYudkowsky是著名的人工智能科學家和作家,同時也是機器智能研究所的聯合創始人,MIRI致力于確保超人工智能對人類具有友善的價值觀。

未來生命研究所的公開信爆火之后,EliezerYudkowsky在《時代》上發表了一篇名為《PausingAIDevelopmentsIsn'tEnough.WeNeedtoShutitAllDown》文章。

在開頭提到他并沒有在上面簽名,因為這封信低估了形勢的嚴重性,提出的要求太少,無法解決問題。

文中提到了當人工智能變得比人類更聰明之后可能造成的危害,EliezerYudkowsky提出了一個相當消極的觀點:

我們還沒準備好。我們沒有在任何合理的時間內做好準備。沒有計劃。人工智能能力的進步是巨大的,遠遠領先于人工智能排列的進步,甚至領先于理解這些系統內部到底發生了什么的進步。如果我們真的這么做,我們都會死的。

EliezerYudkowsky在前不久接受LexFridman的采訪時再次警告,人類沒有第二次校準人工智能的機會,如果人類失敗,人類就將滅亡。

金色周刊是金色財經推出的一檔每周區塊鏈行業總結欄目,內容涵蓋一周重點新聞、行情與合約數據、礦業信息、項目動態、技術進展等行業動態。本文是項目周刊,帶您一覽本周主流項目以及明星項目的進展.

1900/1/1 0:00:00作者:Vitalik;翻譯:金色財經0x25一種未被充分討論但非常重要的以太坊維護其安全性和去中心化的方式是其多客戶端理念.

1900/1/1 0:00:007:00-12:00關鍵詞:Mina、ArthurHayes、FoundryUSA、Bedrock升級1.Mina發布新路線圖:涵蓋ZK可編程性、結算層性能等五個階段;2.

1900/1/1 0:00:007:00-12:00關鍵詞:SushiSwap、peedan.eth、林俊杰、a16z1.安全團隊:SushiSwap項目疑似被攻擊.

1900/1/1 0:00:00金色財經報道,以太坊再質押協議EigenLayer完成5000萬美元的A輪融資,BlockchainCapital領投.

1900/1/1 0:00:00作者寄語: (1)Arbitrum基金會和DAOGovernance為ArbitrumOne和ArbitrumNova網絡啟動.

1900/1/1 0:00:00